L’alterabito era un’invenzione dei Laboratori Bell, scoperta accidentalmente da uno degli addetti tecnici […]. Fondamentalmente il suo progetto consisteva di una lente di quarzo sfaccettata, collegata con un computer miniaturizzato le cui banche della memoria contenevano fino a un milione e mezzo di minute rappresentazioni fisionomiche di numerose persone: uomini e donne, bambini, con ogni sorta di varianti codificate e incorporate e quindi proiettate verso l’esterno in tutte le direzioni nella stessa misura, sopra una membrana sottilissima, larga a sufficienza per aderire alla figura di un uomo di media taglia.

Un oscuro scrutare, Philip K. Dick, 1977

L’alterabito [scramble suit] indossato da Bob Arctor, nome in codice Fred, era in grado di ingannare le più avanzate tecnologie di riconoscimento facciale permettendogli di rimanere anonimo. Le visionarie capacità di Philip K. Dick si confermano nuovamente e, quarantatre anni dopo la pubblicazione del racconto “Un oscuro scrutare” [A scanner darkly], il dibattito sul riconoscimento facciale (e più in generale sui dati biometrici) e privacy è più vivo che mai.

Nonostante la raccolta dei dati facciali non sia una novità, è la capacità (e velocità) di analisi che è esponenzialmente cresciuta negli ultimi anni, rendendo possibile il suo utilizzo in svariati ambiti (vedi la possibilità di check-in all’aeroporto di Linate), grazie anche a prezzi sempre più accessibili dell’hardware necessario.

Durante la giornata di Contesto Urbano abbiamo avuto modo di parlare delle problematiche legate al riconoscimento facciale durante la nostra vita quotidiana in particolare se vissuta all’interno della Smart City e in uno contesto digitale (es: social media).

Ai già noti scenari di come resistere a telecamere o sistemi di sorveglianza, se ne affiancano di nuovi legati a come gli attuali algoritmi di riconoscimento facciale vengono allenati.

Ovvero: da dove le moderne intelligenze artificiali prendono i dati?

A metà gennaio ha destato scandalo la scoperta che Clearview AI, una piccola start-up finanziata inizialmente da Peter Thiel (noto anarco-capitalista e membro del CDA di Facebook), abbia utilizzato video e immagini scaricate da piattaforme come Facebook e Youtube (nonostante la pratica sia proibita) per migliorare il suo database di riconoscimento facciale utilizzato da dipartimenti di Polizia e non solo. Questo non è che la punta dell’iceberg del problema, alcune città come San Francisco stanno correndo ai ripari proibendo l’utilizzo di software di riconoscimento facciale su immagini e video raccolti da Polizia locale ed altri enti Comunali.

Alla luce di ciò abbiamo fatto un piccolo esperimento su un video pubblicato di recente riguardante la giornata di Contesto Urbano. Abbiamo deciso di anonimizzare alcuni volti tramite le stesse tecnologie di machine learning utilizzate dai sistemi di sorveglianza. L’algoritmo si chiama Deep Privacy e, allo stesso modo dell’alterabito, applica un volto casuale ogni frame del video a partire dal volto originale. Non sarà sicuramente La soluzione ma volevamo provare a fermare quel ciclo continuo (e molto spesso inconsapevole) di alimentazione di Intelligenze artificiali che ogni giorno raccolgono i nostri dati per darli in pasto ad algoritmi di profilazione.

Qui trovare il video: https://archive.org/details/contestourbanoonline

Buona visione!

***

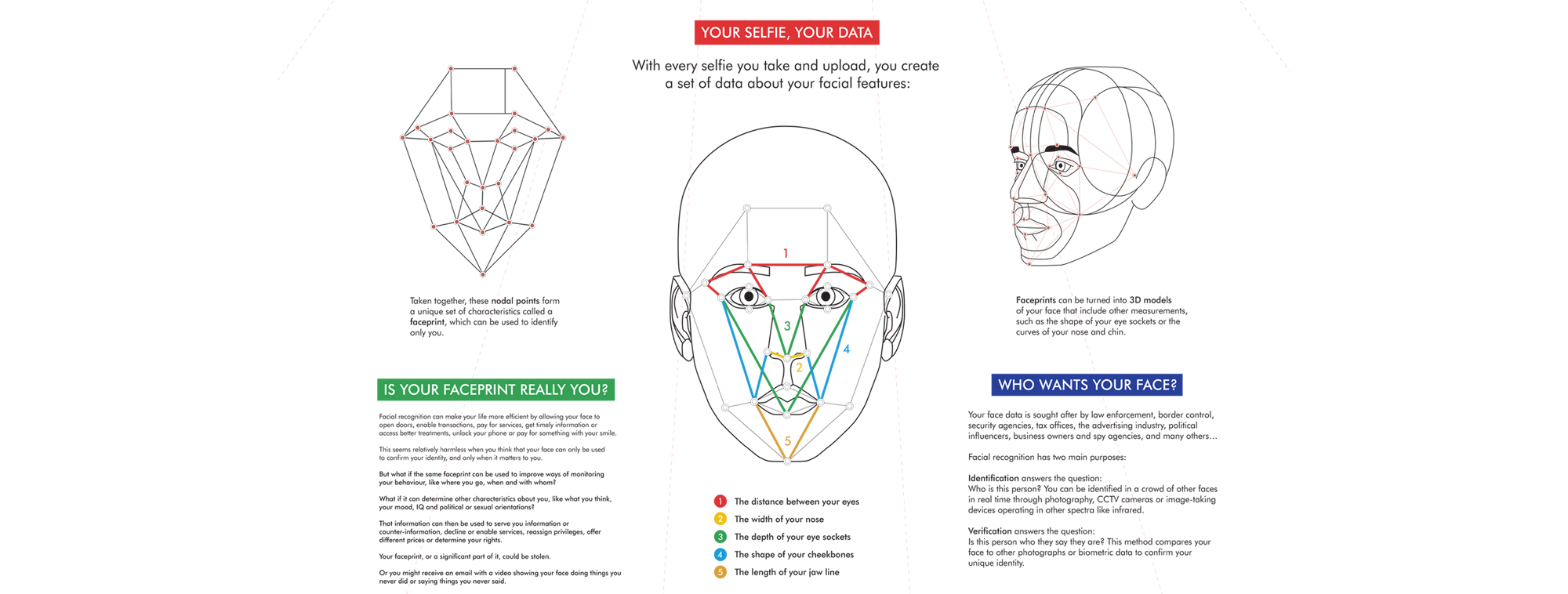

Immagine in copertina: “The Real Life Of Your Selfie” da Klaas Diersmann e Tactical Technology Collective per la mostra “The Glass Room“.